Przełom, który zagrozi ludzkości? OpenAI odkryło coś tuż przed zwolnieniem Altmana

Jak donosi agencja Reutera, powołując się na dwie osoby zaznajomione ze sprawą, grupa pracowników naukowych OpenAI napisała list do zarządu, w którym ostrzegła przed przełomowym odkryciem, które może być zagrożeniem dla ludzkości. Oba źródła podały również, że nieujawniona wcześniej sprawa mogła zaważyć o zwolnieniu Samuela Altmana, który został odsunięty ze stanowiska dyrektora w piątek 18 listopada.

W ostatniej publicznej wypowiedzi przed odwołaniem przez zarząd, Altman stwierdził, że w przyszłym roku możliwości sztucznej inteligencji wzrosną w sposób, jakiego nikt się nie spodziewa. Jego słowa padły podczas forum Współpracy Gospodarczej Azji i Pacyfiku (APEC) w San Francisco.

– Cztery razy w historii OpenAI, ostatni raz było to na przestrzeni kilku tygodni wstecz, miałem okazję być świadkiem momentu, kiedy w pewnym sensie odsłoniliśmy zasłonę niewiedzy i przesunęli naprzód granicę odkryć, a dokonanie tego to zawodowy zaszczyt życia – powiedział Altman podczas szczytu APEC.

Dzień później zarząd zwolnił go podczas spotkania online. Po sadze spekulacji i negocjacji trwającej cały weekend, Altman został przejęty przez Microsoft, żeby we wtorek powrócić na stanowisko dyrektora generalnego OpenAI. Naciski w tej sprawie miały pochodzić od samego Microsoftu, który ceni sobie obecny model współpracy ze start-upem. Gigant jest beneficjentem odkryć związanych ze sztuczną inteligencją, a zachowując odrębność odsuwa od siebie ryzyko (regulacyjne i wizerunkowe).

Czego obawiają się naukowcy OpenAI?

Wątpliwości autorów listu miały dotyczyć zbyt szybkiej komercjalizacji nowego odkrycia przed zrozumieniem, jakie mogą być konsekwencje jego wykorzystania. Według Reutera chodzi o projekt o nazwie Q*, który według niektórych pracowników OpenAI, może być przełomem na drodze do stworzenia tzw. superinteligencji lub inaczej: silnej sztucznej inteligencji (AGI).

Modele AGI mają stać się autonomicznymi systemami, których możliwości przewyższą człowieka w większości prac. Umowa OpenAI z Microsoftem dotyczy technologii na niższym poziomie. Według jej zapisów to zarząd start-upu zdecyduje, czy jego prace osiągnęły już ten etap zaawansowania.

Agencja Reutera nie dotarła do listu i nie ustaliła dokładnych zagrożeń wymienionych przez badaczy. Wiadomo jednak, że na obecnym etapie rozwoju sztuczna inteligencja radzi sobie dobrze z pisaniem, tłumaczeniem na obce języki i przewidywaniem kolejnego słowa, które pojawi się w zdaniu. Odpowiedzi na to samo pytanie mogą znacząco różnić się od siebie.

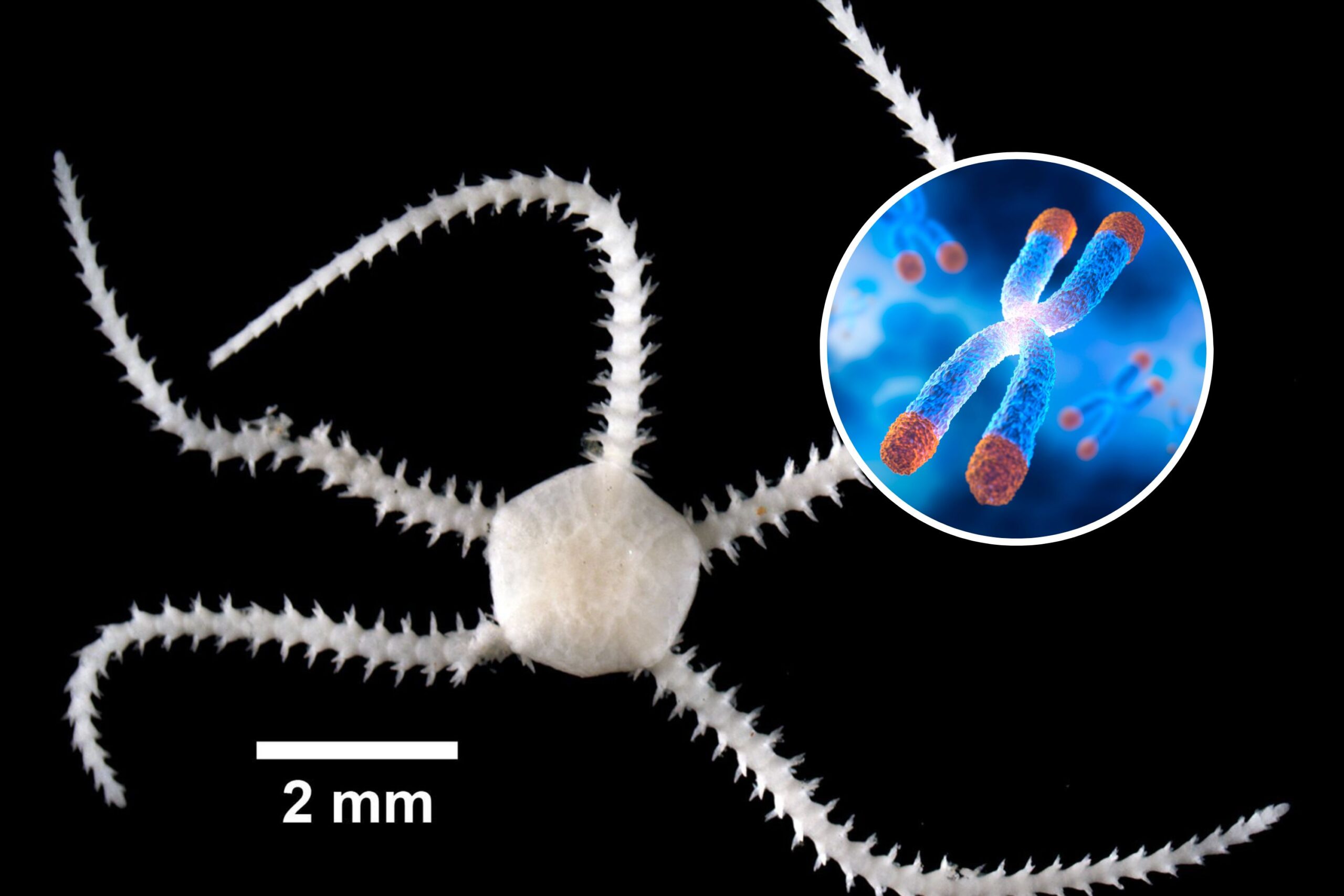

Projekt Q* miał poradzić sobie tymczasem z pewnymi prostymi problemami matematycznymi na poziomie uczniów szkoły podstawowej. Sztuczna inteligencja zaczęła rozwiązywać więc zadania, w których występuje tylko jedna poprawna odpowiedź, co dotychczas nie było dla niej trywialne. To napawało naukowców optymizmem, jeśli chodzi o dalszy, szybki rozwój umiejętności matematycznych. AI, kiedy je posiądzie, może zyskać większe zdolności rozumowania, zacząć przypominać ludzką inteligencję i znaleźć zastosowanie w innowacyjnych badaniach naukowych.